Podcast: Play in new window | Download (Duration: 6:09 — 8.4MB)

(: S'inscrire au podcast via une plateforme : Spotify | Deezer | Youtube Music | RSS

IA et enseignants : pourquoi ignorer cette transformation coûte trop cher

Article publié le 16 avril 2026 · Temps de lecture : 9 minutes ·

Le débat sur l’IA à l’école tourne en rond en ce moment à l’Assemblé Nationale (qui feront l’objet d’une série d’articles très prochainement 😉 Les enseignants qui refusent l’IA au nom de l’éthique croient protéger leurs élèves. Dans les faits, ils les abandonnent à une réalité qu’ils ne comprendront pas. Ce n’est pas une question de technologie. C’est une question de responsabilité pédagogique.

Je suis enseignante et formatrice en devenir, et je travaille avec l’IA depuis le début de la diffusion de l’IA au grand public en 2022 (Midjourney puis Chatgpt). Pas par fascination technologique mais par nécessité stratégique. Et c’est précisément parce que j’observe ce secteur de l’intérieur que le mouvement actuel de résistance me préoccupe sincèrement, sans condescendance.

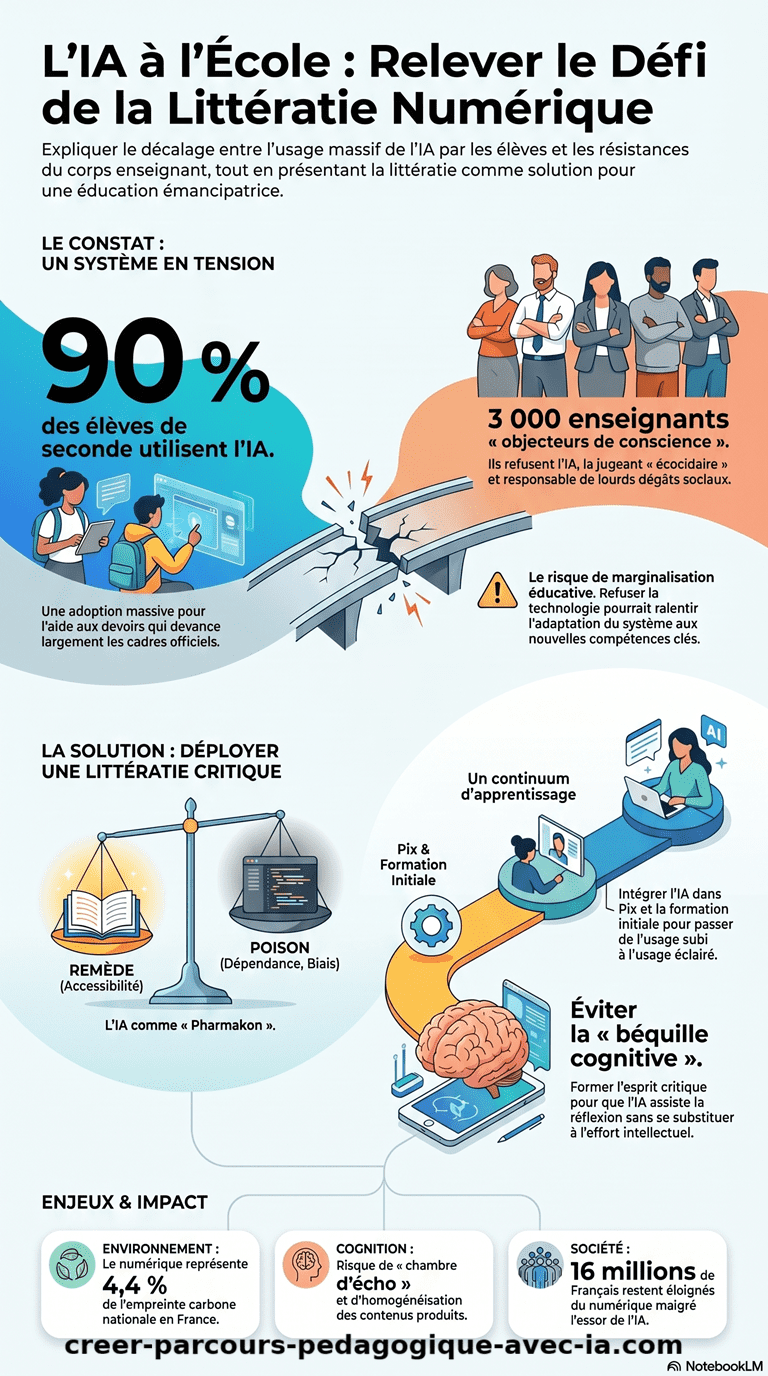

D’ailleurs en parrallèle, un collectif de près de 2800 enseignants se revendique aujourd’hui « objecteurs de conscience » face à l’intelligence artificielle (le terme est très fort quand même! J’y reviendrai plus tard). Leurs arguments sont les suivants : impact écologique, destruction du lien social, vision d’un futur déshumanisé. Des inquiétudes que je comprends. Ce que je comprends moins, c’est quand certains membres de ce collectif affirment que rien ne pourrait les faire changer d’avis. Ce n’est plus une posture critique. C’est une position figée.

Pendant ce temps, le secteur privé n’attend pas. Mark Zuckerberg pilote Meta et ces 78 000 employés via un agent IA personnel. Les ingénieurs qui adoptent pleinement ces outils enregistrent jusqu’à 80 % de gains de productivité. Les 90 000 suppressions de postes documentées depuis 2023 chez des géants comme Amazon ou Meta ne sont pas de simples coupes budgétaires : elles marquent le remplacement des rôles à faible valeur ajoutée par des systèmes automatisés…

Ce n’est pas un article pour ou contre l’IA. Ce n’est pas non plus un article pour culpabiliser les enseignants. C’est un article pour poser une question que je ne peux plus ignorer en tant qu’enseignante et formatrice : que risquent vraiment les élèves d’aujourd’hui si leurs enseignants choisissent de rester en dehors de ce mouvement ?

J’ai synthétisé ce que j’ai compris, après avoir analysé les 2 camps et après avoir choisi le mien :

[FAQ] Les 5 questions clés que se posent les enseignants sur l’IA

Si vous arrivez avec une question précise, voici les réponses directes aux interrogations que pose l’IA aux enseignants.

Quelle est la meilleure IA pour les enseignants ?

Il n’existe pas de meilleure IA universelle. Cela dépend de votre besoin. ChatGPT reste le plus polyvalent (génération de supports, QCM, création de GPT personnalisés). Claude excelle sur le raisonnement long et l’analyse fine de documents. NotebookLM de Google est idéal pour travailler à partir de vos propres sources. La meilleure IA est celle que vous allez vraiment maîtriser, plutôt que de tester superficiellement dix outils différents.

Est-ce que l’IA remplacera les enseignants ?

Pas au sens littéral. Ce qui se redéfinit, c’est la valeur ajoutée humaine. Les rôles consistant à transmettre de l’info brute, corriger mécaniquement, produire des supports standardisés : ce sont ces tâches qui sont sous pression, pas la profession. L’enseignant qui maîtrise l’IA pour gagner du temps sur l’administratif et concentrer son énergie sur la relation et le jugement : celui-là n’est pas menacé.

Quels sont les 3 métiers qui survivront à l’IA ?

Ce ne sont pas les métiers qui survivent, c’est les compétences. Les trois capacités que l’IA ne possède pas : le jugement contextuel dans des situations humaines complexes, la création de relation de confiance sur la durée, et la capacité à piloter l’IA elle-même. L’enseignant peut appartenir à cette catégorie, à une condition : maîtriser l’IA comme outil, pas la refuser.

Quels sont les 5 IA les plus utilisés par les enseignants ?

- ChatGPT (génération de supports, QCM, conversation),

- Claude (raisonnement long, analyse de documents),

- Gemini de Google (synthèse, recherche),

- Copilot de Microsoft (intégration Office),

- NotebookLM de Google (analyse de vos propres documents). Chacun a un usage spécifique. Commencez par un seul, maîtrisez-le, puis explorez les autres.

Comment commencer avec l’IA si je suis enseignant débutant ?

Commencez par les tâches où l’IA économise du temps sans risque : rédiger des emails administratifs, produire des corrigés types, reformuler des consignes pour différents niveaux, générer des variantes d’exercices. Ensuite, progressez vers la conception de parcours ou la génération de QCM. Pas besoin de tout comprendre techniquement. Testez, mesurez le gain, progressez.

IA et enseignants : le contexte qui change tout

L’IA est déjà dans la vie de vos élèves. Le marché du travail qu’ils vont rejoindre dans 5 à 10 ans est déjà reconfiguré par l’IA. Former sans leur donner les outils pour la comprendre et la piloter, c’est les envoyer à l’aveugle.

Depuis 2023, les restructurations ont accumulé des suppressions de postes : 15 000 chez Meta, 16 000 chez Amazon. Le total dépasse les 90 000. Ce ne sont pas des coupes budgétaires conjoncturelles. Elles signalent le remplacement structurel des rôles à faible valeur ajoutée par des agents IA à haut levier. C’est permanent.

Parallèlement, le secteur privé opère une mutation méthodique et chiffrée. Les ingénieurs qui adoptent pleinement ces outils enregistrent jusqu’à 80 % de gains de productivité. Meta a racheté Manus pour 2 milliards de dollars. La vision est claire : un agent IA pour chaque employé. Ce qui se joue ici dépasse l’automatisation des tâches répétitives. Des systèmes comme Claude Code automatisent la réflexion elle-même. Ils agissent comme des consultants seniors capables en quelques minutes de générer des analyses sectorielles ou des roadmaps.

Pendant ce temps, le débat éducatif en France tourne autour de questions morales. Selon un article du Monde de mars 2026, un collectif de près de 2 800 enseignants se revendique aujourd’hui « objecteurs de conscience » face à l’IA générative. Ce n’est pas une critique, c’est l’ampleur de l’inquiétude que je veux signaler.

Pourquoi le débat s’enlise et bloque tout

Le débat autour de l’IA à l’école n’est pas bloqué par manque de données ou d’exemples. Il est bloqué par deux biais cognitifs qui rendent la négociation rationnelle très difficile.

Le premier, c’est le sophisme naturaliste : la sacralisation de ce qui est « naturel » (jugé intrinsèquement bon) face à ce qui est « artificiel » (jugé intrinsèquement mauvais). Dans ce cadre, l’IA perd avant même d’avoir joué. Elle est artificielle par définition, donc suspecte par définition. Peu importe ce qu’elle permet concrètement de faire. Un tableau noir est artificiel. Un manuel scolaire est artificiel. L’école elle-même est une construction artificielle. Ce n’est pas le caractère naturel ou artificiel d’un outil qui détermine sa valeur pédagogique : c’est l’usage qu’on en fait.

Le deuxième, c’est la construction d’un sanctuaire d’obsolescence. L’intention est de protéger. Le résultat risque d’être l’inverse. En refusant ces outils, vous construisez un environnement éducatif volontairement déconnecté de la réalité dans laquelle vos élèves vont évoluer. Ils n’apprendront pas à formuler une instruction précise à une IA, à évaluer la qualité d’une réponse générée, à comprendre les limites de ces systèmes. Ils auront une formation complète en ignorance.

La distinction critique ici est celle-ci : la critique évolutive (qui pose des conditions, des usages acceptables) versus la position figée (« rien ne me changera d’avis »). Certains membres du collectif d’objecteurs affirment explicitement que rien ne pourrait les faire changer d’avis. Ce n’est plus une démarche critique. C’est une impasse.

Le coût réel du refus pour vos élèves

Un élève qui sort du système éducatif sans avoir jamais formulé une instruction précise à une IA, sans avoir évalué la qualité d’une réponse générée, sans avoir compris les limites de ces outils, cet élève est structurellement désavantagé. Le coût n’est pas symbolique. Il est mesurable et immédiat.

Les 90 000 suppressions de postes documentées depuis 2023 ne marquent pas une récession passagère. Elles marquent une redéfinition permanente de ce que les entreprises attendent des humains qui travaillent pour elles. Les rôles à faible valeur ajoutée disparaissent. Les rôles demandant de piloter l’IA deviennent stratégiques. Ce n’est pas une projection. C’est ce qui se passe déjà.

Les élèves qui sortent d’un système éducatif refusant l’IA entrent sur un marché du travail où la capacité à piloter des agents IA est devenue la compétence de référence. Pas une compétence parmi d’autres. La compétence. L’absence de formation crée un désavantage compétitif majeur, difficile à rattraper une fois sur le terrain professionnel.

Un système opérationnel IA performant coûte aujourd’hui environ 200 euros par mois. Pour ce prix, un cadre dispose d’une capacité d’analyse stratégique disponible 24 heures sur 24. Ignorer ce ratio coût sur valeur à l’échelle d’un système éducatif national n’est pas une posture éthique. C’est une négligence économique.

3 pistes concrètes pour intégrer l’IA sans révolution

Je ne crois pas aux transformations radicales imposées de l’extérieur. Les changements durables commencent toujours par un geste petit, concret, réversible. Voici les trois axes les plus accessibles.

Piste 1 : Passer de la critique morale à la maîtrise technique. Non pas abandonner tout esprit critique face à l’IA, mais déplacer le curseur du débat moral vers la formation opérationnelle. Tant qu’on reste dans le registre « l’IA est bonne ou mauvaise », on ne fait rien. Quand on commence à se demander « qu’est-ce que cet outil peut faire concrètement pour moi cette semaine », quelque chose change. L’apprentissage de systèmes comme Claude ou ChatGPT doit devenir une priorité pour transformer les enseignants en pilotes de systèmes experts plutôt qu’en opposants passifs. Ce n’est pas une capitulation. C’est une reprise de contrôle.

Piste 2 : Identifier vos tâches à faible valeur ajoutée et tester l’IA dessus. Personne ne vous demande de confier votre cours magistral à une machine. Ce que l’IA peut absorber en premier, ce sont les tâches que vous faites déjà en pilote automatique : rédiger des emails administratifs, produire des corrigés types, reformuler des consignes pour différents niveaux, générer des variantes d’exercices. C’est sur ces tâches-là que le rapport coût sur bénéfice est le plus immédiat. Et c’est en commençant là que vous développez progressivement une vraie maîtrise opérationnelle.

Piste 3 : Former vos élèves à piloter l’IA, pas à la subir. C’est la piste la plus importante. L’éthique réelle face à l’IA ne consiste pas à protéger les élèves de cet outil. Elle consiste à garantir que chaque élève la maîtrise suffisamment pour ne pas subir le marché du travail, mais pour le diriger. Former à : formuler une instruction précise, évaluer la qualité d’une réponse générée, comprendre les limites. C’est former à la pensée critique appliquée aux outils du présent. Ce n’est pas trahir la pédagogie. C’est l’exercer pleinement.

Identifier vos priorités IA en 2 minutes

Si vous avez l’impression de courir après le temps sans savoir où concentrer vos efforts, cet audit court vous aide à y voir plus clair sur les tâches où l’IA peut réellement vous faire gagner du temps en tant que formateur. Il prend 2 minutes à compléter.

Ou bien si vous êtes sur ordinateur vous pouvez remplir le formulaire plus facilement ci-dessous :

Mon résumé IA en vidéo :

Regarder la vidéo sur YouTube →

Pour aller plus loin sur l’intégration de l’IA, vous pouvez consulter mon guide sur les meilleures IA pour enseignants, mon article sur comment commencer à utiliser l’IA sans se noyer, ou ma réflexion sur l’organisation du temps avec l’IA pour formateurs.

Henri Poincaré, dans « La science et l’hypothèse », a écrit : « Douter de tout ou tout croire sont deux solutions également commodes, qui l’une et l’autre nous dispensent de réfléchir. ». Concernant les « objecteurs », c’est sûr qu’il est plus confortable (pour l’instant) de s’ériger en chevalier blanc que de se former aux nouvelles technologies. Par bonheur, la grande majorité des enseignants sont des gens curieux, enthousiastes et altruistes !

Je pense que c’est un faux débat. Pour moi, il y a une compétence à développer dans un monde où l’IA et la génération de contenu avec ia est omniprésente : l’esprit critique. Il y a trop de personne qui régurgite un contenu d’Ia sans verif. Et puis, c’est un peu comme si on interdisait la calculatrice en maths ou l’informatique pour rédiger ses rapports/ exposés… Je comprends le blocage mais la vocation de l’éducation est bien de préparer la future génération aux conditions de travail à l’avenir???

Merci pour cet article qui tombe à pic ! Je suis formatrice moi aussi et je me retrouve complètement dans ce que tu décris, le débat tourne en rond pendant que le monde avance. La distinction entre critique évolutive et position figée est exactement ce qu’il manquait pour nommer le problème clairement. 🙌

Excellent article. Fin et pertinent.